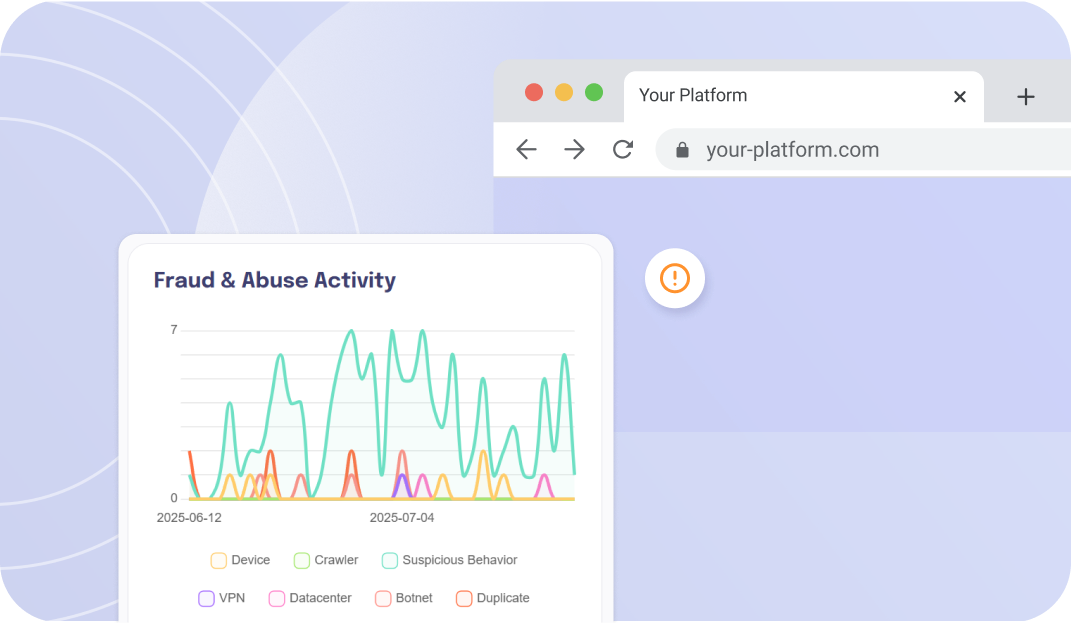

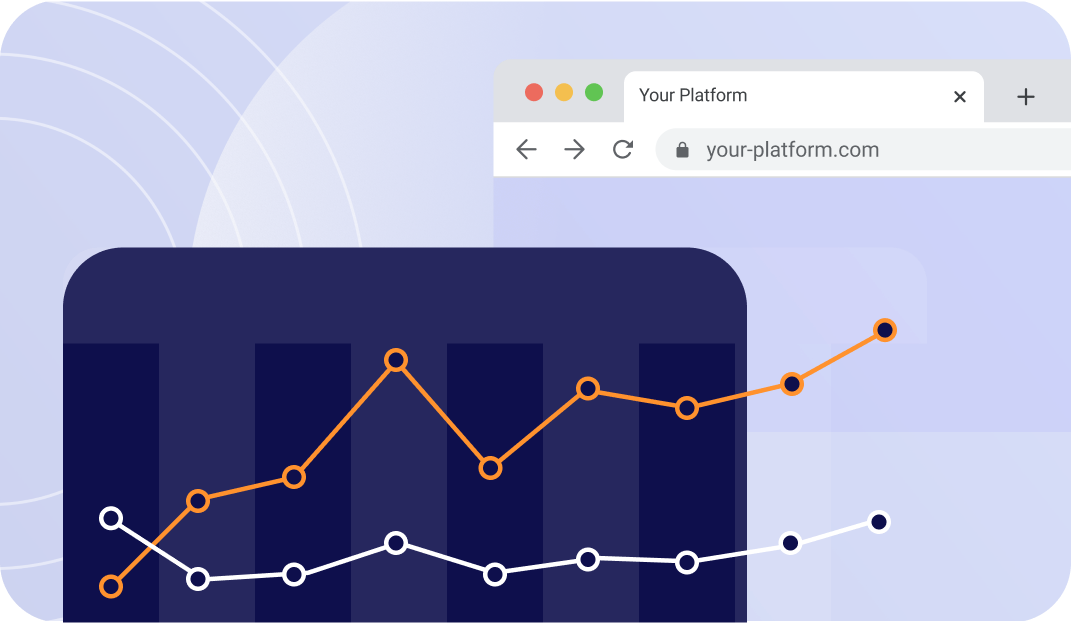

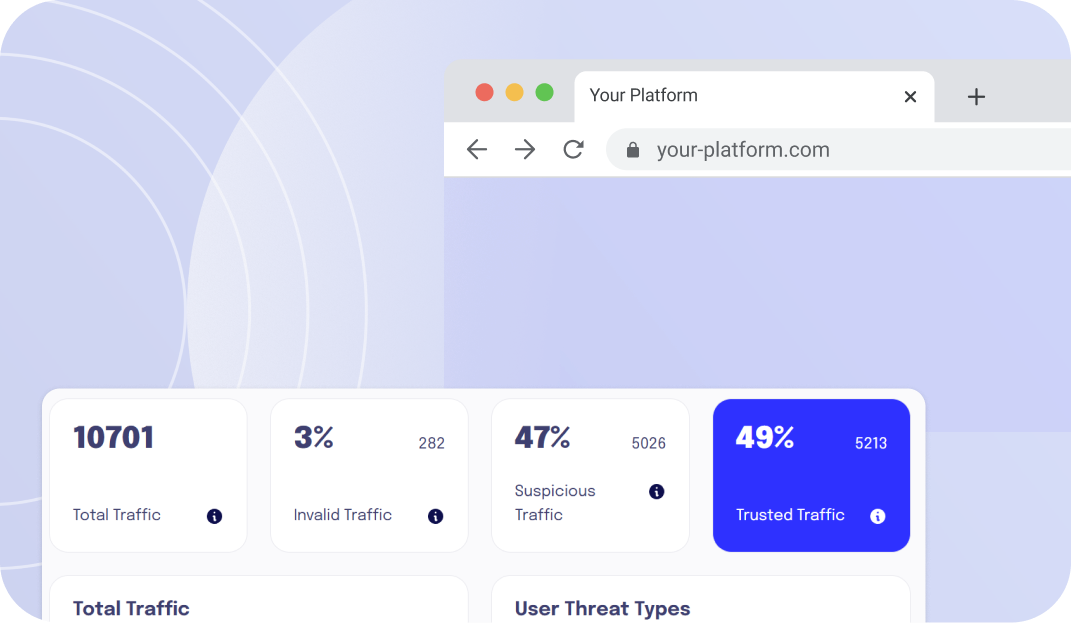

Verhindern Sie, dass Bots und koordinierte Gruppen Ihre Umfragen und Trends manipulieren.

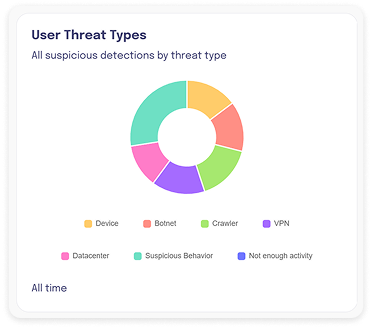

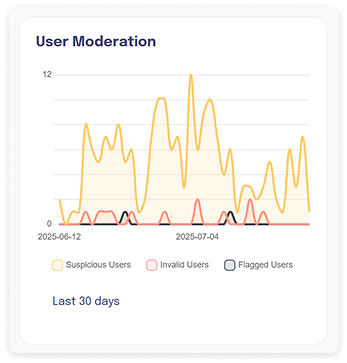

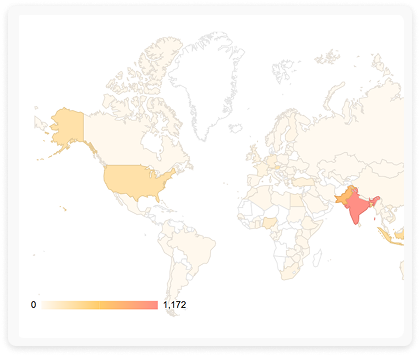

Gefälschte Konten, Bots und koordinierte Akteure können manipulieren Sie Abstimmungen, Umfragen und Trendthemen — untergräbt das Vertrauen der Nutzer und schädigt Ihre Glaubwürdigkeit. Vertrauenswürdige Konten verhindern Manipulationen an der Quelle, sodass die Ergebnisse echt bleiben.